在当今数据驱动的世界中,分布式存储系统已成为支撑海量数据处理和存储服务的基石。其核心挑战之一——数据强一致性,却像一个精妙的赌局,许多声称“看懂”的人,实则可能并未窥其全貌。本文将深入剖析分布式存储系统中实现数据强一致性的复杂挑战,及其对上层数据处理和存储服务的深刻影响。

一、强一致性的“赌局”:理想与现实的博弈

数据强一致性要求在任何时刻,从任何节点读取的数据都是最新的写入结果。这在单机系统中是自然而然的,但在分布式环境中,却成了一场与网络延迟、节点故障和分区容忍性对赌的博弈。著名的CAP定理早已指明:在网络分区(P)不可避免的分布式系统中,我们必须在一致性(C)和可用性(A)之间做出权衡。追求强一致性,往往意味着在特定场景下需要以牺牲部分可用性或性能为代价。

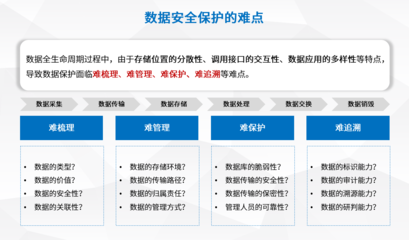

二、核心挑战:一致性背后的“隐形墙”

- 网络延迟与消息传递的不确定性:数据在节点间同步需要时间,网络延迟和乱序使得“同时看到相同数据”变得极其困难。

- 并发写入冲突:当多个客户端同时写入同一数据项时,如何确定最终值并让所有节点达成共识?

- 节点故障与恢复:一个节点在写入过程中宕机,或恢复后如何与集群同步,而不破坏一致性?

- 性能与一致性的平衡:强一致性协议(如两阶段提交、Raft、Paxos)通常伴随着更高的延迟和吞吐量损耗,这对实时数据处理服务是严峻考验。

三、关键技术方案:如何在这场“赌局”中制胜?

为了应对挑战,业界发展出多种技术和协议:

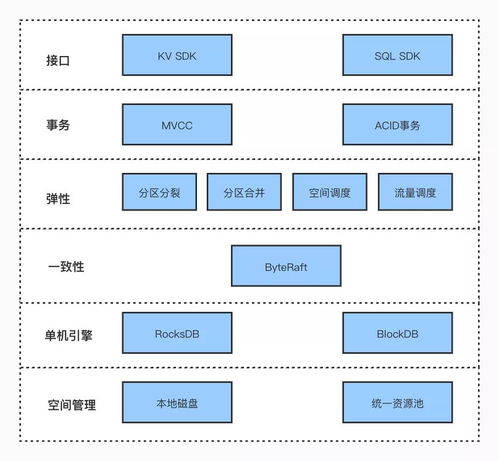

- 共识算法:如Paxos、Raft,通过严格的投票和日志复制机制,在多数节点存活的前提下确保操作的线性一致性和状态机复制,是实现强一致性的核心。

- 分布式事务:通过两阶段提交(2PC)等协议,保障跨多个数据分片或服务的ACID属性,但复杂性和性能开销较大。

- 版本向量与冲突解决:在一些最终一致性系统中,通过版本向量识别冲突,并结合业务逻辑(如“最后写入获胜”或用户调解)解决冲突,但这通常属于弱一致性或最终一致性范畴。

- Quorum机制:在读写操作中设定必须成功的节点数量(如W+R>N),在性能和一致性之间提供可配置的平衡点。

四、对数据处理与存储服务的冲击波

强一致性的选择直接影响上层服务的架构与体验:

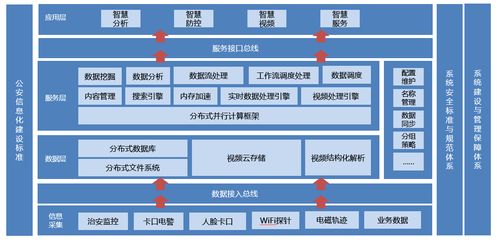

- 数据库服务:关系型数据库的分布式版本(如Google Spanner、TiDB)通过精密的时间戳和共识算法提供外部一致性,而许多NoSQL数据库则明确选择最终一致性以换取可扩展性。

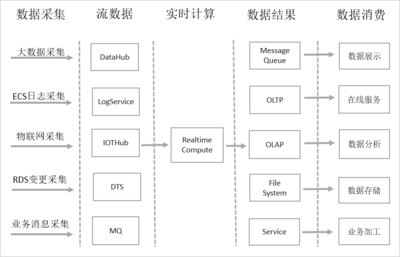

- 实时数据处理:金融交易、库存管理等场景要求强一致性,这迫使流处理框架需要与强一致性存储深度集成,或自身实现状态的一致性管理。

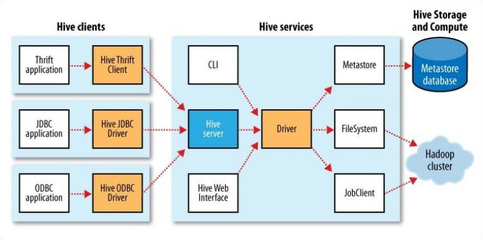

- 存储服务设计:对象存储或文件系统(如Ceph、HDFS)针对不同场景提供不同的一致性级别。强一致性保障使得元数据管理变得复杂,但能确保客户端不会读到陈旧的文件列表或属性。

- 开发复杂度:强一致性系统简化了应用层逻辑(开发者可以像使用单机数据库一样编程),但将复杂性转移到了基础设施层,对运维提出了更高要求。

五、未来展望:超越简单的赌注

强一致性的挑战并非一个非此即彼的赌注。未来趋势正朝着更智能、更自适应的方向发展:

- 可调一致性:系统允许应用根据操作类型或业务重要性,动态选择一致性级别(如从强一致性到最终一致性)。

- 硬件助力:RDMA网络、可持久内存(PMem)等新硬件降低了网络延迟和数据持久化开销,为强一致性协议的性能提升打开了新空间。

- 新共识算法与协议:更高效、更易理解的共识算法(如VRR)仍在不断涌现,旨在降低强一致性的实现成本。

###

分布式存储系统的数据强一致性挑战,绝非一个可以轻率“下注”或宣称“看懂”的简单问题。它是一场贯穿于系统设计、协议实现与业务适配的持续权衡。理解这场博弈的底层逻辑,并根据自身数据处理与存储服务的具体需求——是追求绝对的准确,还是拥抱更优的性能与可用性——做出明智的架构选择,才是真正“看懂”并驾驭分布式存储的关键所在。毕竟,在数据的浩瀚世界里,真正的胜者不是赌徒,而是那些深刻理解规则并善用工具的建筑师。